Autonome køretøjer

Drift af autonome køretøjer med kvalitetsuddannelsesdata

Meget nøjagtige AI-træningsdata til autonome køretøjer, der er fejlfrie, menneskemærkede og omkostningseffektive

Fremhævede klienter

Styrke teams til at opbygge verdensledende AI-produkter.

Der er en stigende efterspørgsel efter automotive datasæt til at træne Machine Learning-modeller, og AI spiller en afgørende rolle ved at behandle enorme mængder af data, som er langt uden for vores kontrol.

Biler og biler generelt spiller en afgørende rolle i vores daglige liv, og de fleste mennesker vil ikke benægte det faktum, at førerløse biler er den fremtid, der er sat til at revolutionere, hvordan vi pendler.

Ifølge Goldman Sachs er de næste 10 år afgørende for bilindustrien, da den vil gennemgå en større transformation: bilerne selv, de virksomheder, der bygger dem, og kunderne - alle vil se markant anderledes ud, end det var før.

Branche:

Med $4.5 milliarder dollars i investering i 2019-AV'er har potentialet til at revolutionere bilindustrien, forbedre sikkerheden, reducere overbelastning, energiforbrug og forurening.

Branche:

I henhold til en nylig rapport fra IHS Markit forventes det, at omkring 33 millioner AV'er vil ramme vejen inden 2040 og bidrage til 26 procent af salget af nye biler.

Ifølge en nylig rapport fra Allied Market Research forventes det globale autonome køretøjsmarked at nå 556.67 milliarder dollars i 2026 og registrere en CAGR på 39.47% fra 2019 til 2026.

En sund mængde bilekspertise

Giver nye teknologier mulighed for at køre på den næste bølge af tilsluttede køretøjer. Shaip er en førende AI-dataplatform, der leverer dataindsamling og annotering af høj kvalitet, der driver ML- og AI-applikationer på tværs af bilindustrien.

Dataindsamlingstjenester

Indsamling af billeddata til bilindustrien

Vi tilbyder store mængder billeddatasæt (person, køretøj, trafikskilte, vejbaner) til at uddanne autonome køretøjer i en række scenarier og situationer. Vores eksperter kan indsamle relevante billeddatasæt efter dine projektkrav.

Indsamling af videodata til biler

Saml handlingsbare træningsvideo-datasæt som køretøjsbevægelse, trafiksignaler, fodgængere osv. For at træne autonome køretøjer ML-modeller. Hvert datasæt er skræddersyet specifikt til at imødekomme din specifikke brugssag.

Datanotationstjenester

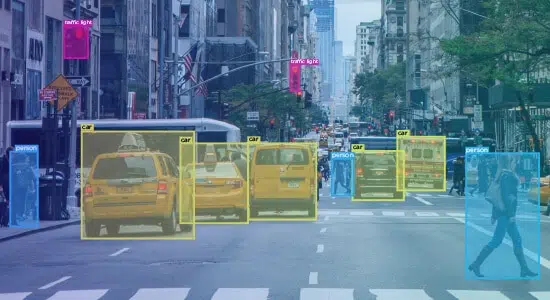

Vi har et af de mest avancerede billed-/videoannoteringsværktøjer i

marked, der gør billedmærkning præcis og superfunktionel til

komplekse use cases såsom autonom kørsel, hvor kvalitet er af største vigtighed. Billeder og videoer kategoriseres billede for billede i objekter såsom fodgængere, køretøjer, veje, lygtepæle, trafikskilte osv. for at opbygge træningsdata af høj kvalitet.

Datanoteringsteknikker til selvkørende biler

Vi hjælper dig med forskellige mærkningsteknikker efter nøje at have studeret dit bilprojektomfang. Vi har en dedikeret arbejdsstyrke, der er uddannet til sådan en kompleks kommentar, QA-teams, der sikrer 95% + mærkeringsnøjagtighedsniveauer, og værktøjer til at automatisere kvalitetskontrol. Afhængigt af dit maskinindlæringsprojekt vil vi arbejde på en eller en kombination af disse billedkommenteringsteknikker:

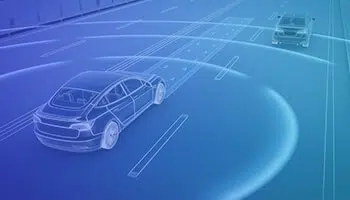

LIDAR

Vi kan mærke billeder eller videoer med 360-graders synlighed, optaget af højopløsningskameraer, for at bygge højkvalitets, jordsandhedsdatasæt, der driver autonome køretøjers algoritme.

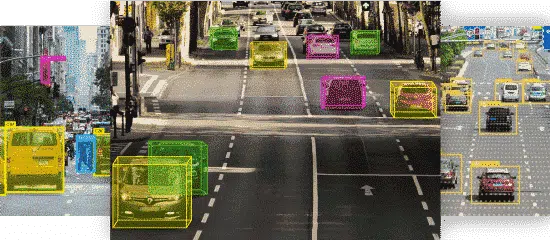

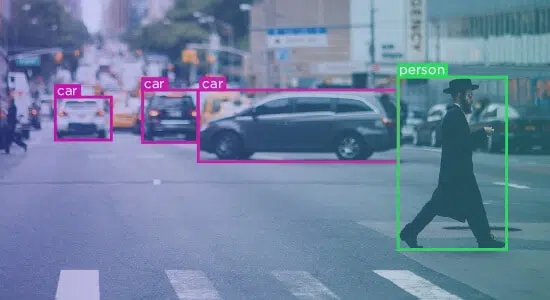

AFGRÆNSNINGSKASSER

Vores eksperter bruger box-annotationsteknikken til at kortlægge objekter i et givet billede / video til at oprette datasæt og derved gøre det muligt for ML-modeller at identificere og lokalisere objekter.

POLYGON ANMÆRKNING

I denne teknik tegner kommentatorer punkter på objektets (som Edge of Road, Broken Lane, End of Lane) nøjagtige kanter, der skal kommenteres, uanset deres form

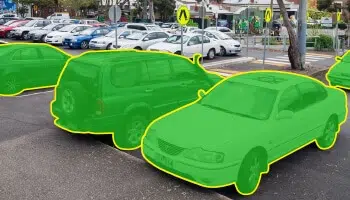

SEMANTISK SEGMENTATION

I denne teknik er hver pixel i et billede / video kommenteret med information og adskilt i forskellige segmenter, du har brug for din cv-algoritme til at genkende

MÅLSPORING

Auto-detekter forekomster af semantiske objekter af en bestemt klasse i digitale billeder og videoer. Brugssager kan omfatte ansigtsgenkendelse og detektering af fodgængere.

Brug cases

Driverovervågningssystem

Byg et meget nøjagtigt førerovervågningssystem ved at annotere ansigts-vartegn såsom øjne, hoved, mund osv. med nøjagtighed og relevante metadata til blinkdetektion og estimering af blik.

Sporingssystem til fodgængere

Kommenter fodgængere i forskellige billeder med 2D-afgrænsningsbokse for at oprette træningsdata af høj kvalitet til sporing af fodgængere

Automatiseret førerassistentsystem

Semantisk segmentering af billeder / videoer ramme for ramme, der inkluderer genstande som fodgængere, køretøjer - (biler, cykler, busser), veje, lygtepæle til opbygning af træningsdata af høj kvalitet til AI-baserede autonome køretøjssystemer.

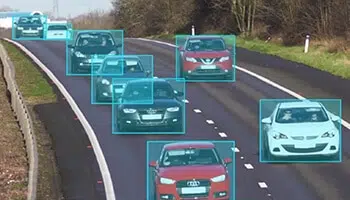

Objektdetektion

Kommenter timer af billeder/videorammer af by- og gademiljøer, inklusive biler, fodgængere, lygtepæle osv. for at lette genstandsgenkendelse for at opbygge træningsdata af høj kvalitet til udvikling af CV-modeller til autonome køretøjer.

Driver Døsighed/træthedsregistrering

Reducer trafikulykker forårsaget af chauffører, der falder i søvn, ved at indsamle vigtige informationer om føreren fra vartegn i ansigtet, såsom døsighed, øjenblik, distraktion, følelser og mere. Disse billeder i kabinen er nøjagtigt kommenterede og bruges til træning af ML-modeller.

Stemmeassistent i kabinen

Forbedre stemmegenkendelse i bilens eller bilens stemmeassistent ved at gøre det muligt for chauffører at foretage telefonopkald, styre musik, afgive ordrer, booke tjenester, planlægge aftaler og mere. Vi tilbyder sproglige datasæt på mere end 50 sprog for at træne din bilstemmeassistent.

Hvorfor Shaip?

Administreret arbejdsstyrke til komplet kontrol, pålidelighed og produktivitet

En kraftfuld platform, der understøtter forskellige typer kommentarer

Minimum 95% nøjagtighed sikres for overlegen kvalitet

Globale projekter i mere end 60 lande

SLA'er af virksomhedskvalitet

Klassens bedste datasæt i det virkelige liv

Autonome kørselsdatasæt

Bilinteriør billeddatasæt

Annoterede billeder (sammen med metadata) af forskellige bilinteriører fra flere mærker

- Brug Case: Bilinteriør billedgenkendelse

- Format: Billeder

- Kommentar: Segmentering

Udendørs billeddatasæt

Billeder af udendørs miljøer på gadeniveau i byområder eller på motorveje med hyppig trafik

- Brug Case: Billedanonymiseringsløsning

- Format: Billeder

- Kommentar: Ja

Bilfører i fokus Billeddatasæt

Billeder af førerens ansigt med bilopsætning i forskellige positurer og variationer, der dækker unikke deltagere fra flere etniciteter

- Brug Case: ADAS-model i bilen

- Format: Billeder

- Kommentar: Ingen

Datasæt til køretøjets nummerplade

Billeder af køretøjsnummerplader fra forskellige vinkler

- Brug Case: Objektdetektion

- Format: Billeder

- Kommentar: Ingen

Vores evne

Mennesker

Dedikerede og uddannede hold:

- 30,000+ samarbejdspartnere til oprettelse af data, mærkning og kvalitetssikring

- Godkendt projektledelsesteam

- Erfaren produktudviklingsteam

- Talent Pool Sourcing & Onboarding Team

Proces

Højeste proceseffektivitet sikres med:

- Robust 6 Sigma Stage-Gate-proces

- Et dedikeret team med 6 Sigma-sorte bælter - Nøgleprocessejere og overholdelse af kvalitet

- Løbende forbedring og feedback

perron

Den patenterede platform giver fordele:

- Web-baseret ende-til-ende platform

- Upåklagelig kvalitet

- Hurtigere TAT

- Problemfri levering

Mennesker

Dedikerede og uddannede hold:

- 30,000+ samarbejdspartnere til oprettelse af data, mærkning og kvalitetssikring

- Godkendt projektledelsesteam

- Erfaren produktudviklingsteam

- Talent Pool Sourcing & Onboarding Team

Proces

Højeste proceseffektivitet sikres med:

- Robust 6 Sigma Stage-Gate-proces

- Et dedikeret team med 6 Sigma-sorte bælter - Nøgleprocessejere og overholdelse af kvalitet

- Løbende forbedring og feedback

perron

Den patenterede platform giver fordele:

- Web-baseret ende-til-ende platform

- Upåklagelig kvalitet

- Hurtigere TAT

- Problemfri levering

Leder du efter en GRATIS konsultation? Lad os forbinde!