Den komplette guide til Conversational AI

Den ultimative køberguide 2024

Introduktion

Ingen man i disse dage stopper op for at spørge, hvornår sidste gang du talte med en chatbot eller en virtuel assistent var? I stedet har maskiner spillet vores yndlingssang, der hurtigt identificerer et lokalt kinesisk sted, der leverer til din adresse og håndterer forespørgsler midt om natten – med lethed.

Hvem er denne vejledning til?

Denne omfattende guide er til:

- Alle jer iværksættere og soloprenører, som jævnligt maser enorme mængder data

- AI og maskinindlæring eller fagfolk, der kommer i gang med procesoptimeringsteknikker

- Projektledere, der har til hensigt at implementere en hurtigere time-to-market for deres AI-modeller eller AI-drevne produkter

- Og tech-entusiaster, der kan lide at komme ind i detaljerne i de lag, der er involveret i AI-processer.

Hvad er Conversational AI

Conversational AI er en avanceret form for kunstig intelligens, der gør det muligt for maskiner at indgå i interaktive, menneskelignende dialoger med brugerne. Denne teknologi forstår og fortolker menneskeligt sprog for at simulere naturlige samtaler. Det kan lære af interaktioner over tid for at reagere kontekstuelt.

Konversations-AI-systemer er meget brugt i applikationer som chatbots, stemmeassistenter og kundesupportplatforme på tværs af digitale og telekommunikationskanaler.

Konversations-AI-markedet har oplevet hurtig vækst i de seneste år. Oprindeligt udviklet til underholdningsformål, er konversations-AI blevet en integreret del af det digitale økosystem. Her er nogle nøglestatistikker for at illustrere dens virkning:

- Det globale konversations-AI-marked blev vurderet til $6.8 milliarder i 2021 og forventes at vokse til $18.4 milliarder i 2026 ved en CAGR på 22.6%. I 2028 forventes markedsstørrelsen at nå $ 29.8 milliarder.

- På trods af dens udbredelse, 63 % af brugerne er uvidende om, at de bruger kunstig intelligens i deres daglige liv.

- A Gartner-undersøgelse fandt, at mange virksomheder identificerede chatbots som deres primære AI-applikation, hvor næsten 70 % af funktionærerne forventes at interagere med samtaleplatforme dagligt i 2022.

- Siden pandemien er mængden af interaktioner, der håndteres af samtaleagenter, steget med lige så meget som 250 % på tværs af flere brancher.

- Andelen af marketingfolk, der bruger kunstig intelligens til digital markedsføring på verdensplan steg dramatisk fra 29 % i 2018 til 84% i 2020.

- I 2022, blev 91 % af voksne stemmeassistentbrugere brugte samtale-AI-teknologi på deres smartphones.

- Gennemse og søge efter produkter var de top shopping aktiviteter udført ved hjælp af stemmeassistentteknologi blandt amerikanske brugere i en undersøgelse fra 2021.

- Blandt tekniske fagfolk verden over, næsten 80 % bruge virtuelle assistenter til kundeservice.

- I 2024 mener 73 % af de nordamerikanske kundeservicebeslutningstagere, at onlinechat, videochat, chatbots eller sociale medier vil være mest brugte kundeservicekanaler.

- I en undersøgelse fra 2021, 86 % af amerikanske ledere blev enige om, at kunstig intelligens ville blive en "mainstream-teknologi" i deres virksomhed.

- Fra februar 2022, 53 % af amerikanske voksne havde kommunikeret med en AI-chatbot til kundeservice i det sidste år.

- I 2022, blev 3.5 milliarder chatbot-apps blev tilgået over hele verden.

- top tre grunde Amerikanske forbrugere bruger en chatbot til åbningstider (18%), produktinformation (17%) og kundeserviceanmodninger (16%).

Disse statistikker fremhæver den stigende indførelse og indflydelse af samtale-AI på tværs af forskellige industrier og forbrugeradfærd.

Hvordan fungerer Conversational AI

Conversational AI bruger naturlig sprogbehandling (NLP) og andre sofistikerede algoritmer til at indgå i kontekstrige dialoger. Efterhånden som AI møder et bredere udvalg af brugerinput, forbedrer det dets mønstergenkendelse og forudsigelsesevner. Processen med samtale-AI, der interagerer med brugere, kan opdeles i fire nøgletrin:

Trin 1: Indsamling af input – Brugere giver deres input enten via tekst eller stemme.

Trin 2: Inputbehandling – Når input er i tekstform, bruges naturlig sprogforståelse (NLU) til at udtrække mening fra ordene. Til stemmeinput anvendes automatisk talegenkendelse (ASR) først til at konvertere lyd til sprogtokens, der kan analyseres yderligere.

Trin 3: Generering af svar – Naturlige sproggenereringsteknikker bruges til at reagere korrekt på brugerens forespørgsel.

Trin 4: Kontinuerlig forbedring – Konversations-AI-systemer analyserer brugerinput over tid og forfiner deres svar for at sikre nøjagtighed og relevans.

Typer af Conversational AI

Conversational AI kan i høj grad gavne virksomheder ved at imødekomme forskellige behov og levere skræddersyede løsninger. Der er tre hovedtyper af konversations-AI: chatbots, stemmeassistenter og interaktive stemmesvar. Valget af den rigtige model afhænger af dine forretningsmål og anvendelsesmuligheder.

chatbots

Chatbots er tekstbaserede AI-værktøjer, der engagerer brugere via beskeder eller websteder. De kan være regelbaserede, AI/NLP-drevne eller hybride. Chatbots automatiserer kundesupport, salg og leadgenereringsopgaver, mens de tilbyder personlig assistance.

Stemmeassistenter

Stemmeassistenter (VA) muliggør interaktion gennem stemmekommandoer. De behandler talesprog for håndfrit engagement og findes i smartphones og højttalere. VA'er hjælper med kundesupport, aftaleplanlægning, vejledning og ofte stillede spørgsmål.

IVR

IVR'er er regelbaserede telefonisystemer, der tillader interaktion via stemmekommandoer eller touch-tone input. De automatiserer opkaldsdirigering, informationsindsamling og selvbetjeningsmuligheder. IVR'er håndterer effektivt høje opkaldsvolumener i kunde og salg.

Forskellen mellem AI og regelbaseret chatbot

| AI/NLP Chatbot | Regelbaseret chatbot |

| Forstår og interagerer med stemme- og tekstkommandoer | Forstår og interagerer kun med tekstkommandoer |

| Kan forstå sammenhængen og fortolke hensigten i en samtale | Kan følge forudbestemt chatflow, den er blevet trænet i |

| Designet til at have samtale dialoger | Designet til rent navigation |

| Fungerer på flere grænseflader såsom blogs og virtuelle assistenter | Fungerer kun som en chat-supportgrænseflade |

| Kan lære af interaktioner, samtaler | Det følger et foruddesignet sæt regler og skal konfigureres med nye opdateringer |

| Kræver masser af tid, data og ressourcer at træne | Hurtigere og billigere at træne |

| Kan give tilpassede svar baseret på interaktionerne | Udfører forudsigelige opgaver |

| Ideel til komplekse projekter, der kræver avanceret beslutningstagning | Ideel til mere ligetil og veldefinerede brugssager |

Fordele ved Conversational AI

Conversational AI er blevet mere og mere avanceret, intuitiv og omkostningseffektiv, hvilket fører til udbredt anvendelse på tværs af brancher. Lad os undersøge de væsentlige fordele ved denne innovative teknologi mere detaljeret:

Personlige samtaler på tværs af flere kanaler

Conversational AI gør det muligt for organisationer at levere kundeservice i topklasse gennem personaliserede interaktioner på tværs af forskellige kanaler, hvilket giver en problemfri kunderejse fra sociale medier til live webchats.

Skaler ubesværet for at administrere høje opkaldsvolumener

Konversations-AI kan hjælpe kundeserviceteams med at håndtere pludselige stigninger i opkaldsvolumen ved at kategorisere interaktioner baseret på kundens hensigt, krav, opkaldshistorik og følelser. Dette muliggør effektiv routing af opkald, hvilket sikrer, at live-agenter håndterer interaktioner af høj værdi, mens chatbots administrerer ringe værdi.

Løft kundeservice

Kundeoplevelsen er blevet en væsentlig branddifferentiering. Conversational AI hjælper virksomheder med at levere positive oplevelser. Det giver øjeblikkelige, præcise svar på forespørgsler og udvikler kundecentrerede svar ved hjælp af talegenkendelsesteknologi, sentimentanalyse og hensigtsgenkendelse.

Understøtter marketing- og salgsinitiativer

Conversational AI giver virksomheder mulighed for at skabe unikke mærkeidentiteter og opnå en konkurrencefordel på markedet. Virksomheder kan integrere AI-chatbots i marketingmixet for at udvikle omfattende køberprofiler, forstå købspræferencer og designe personligt tilpasset indhold skræddersyet til kundernes behov.

Bedre omkostningsbesparelser med automatiseret kundepleje

Chatbots giver omkostningseffektivitet med forudsigelser om, at de vil redde virksomheder 8 milliarder dollars årligt i 2022. Udvikling af chatbots til at håndtere enkle og komplekse forespørgsler reducerer behovet for løbende uddannelse af kundeservicemedarbejdere. Selvom de indledende implementeringsomkostninger kan være høje, opvejer de langsigtede fordele den oprindelige investering.

Flersproget support til global rækkevidde

Conversational AI kan programmeres til at understøtte flere sprog, hvilket gør det muligt for virksomheder at henvende sig til en global kundebase. Denne evne hjælper virksomheder med at yde problemfri support til ikke-engelsktalende kunder, bryde sprogbarrierer og forbedre den overordnede kundetilfredshed.

Forbedret dataindsamling og analyse

Konversations-AI-platforme kan indsamle og analysere enorme mængder kundedata og tilbyde uvurderlig indsigt i kundeadfærd, præferencer og bekymringer. Denne datadrevne tilgang hjælper virksomheder med at træffe informerede beslutninger, forfine marketingstrategier og udvikle bedre produkter og tjenester. Ydermere forbedrer denne kontinuerlige datastrøm AI's indlæringsevne, hvilket fører til mere præcise og effektive svar over tid.

24/7 tilgængelighed

Conversational AI kan yde support døgnet rundt, hvilket sikrer, at kunder får assistance, når det er nødvendigt, uanset tidszoner eller helligdage. Denne kontinuerlige tilgængelighed er især vigtig for virksomheder med globale aktiviteter eller kunder, der har behov for support uden for traditionelle åbningstider.

Eksempel på Conversational AI

Mange store og små virksomheder bruger AI-drevne chatbots og virtuelle hjælpere på sociale medier. Disse værktøjer hjælper virksomheder med at interagere med kunder, besvare spørgsmål og yde support hurtigt og nemt. Her er nogle eksempler:

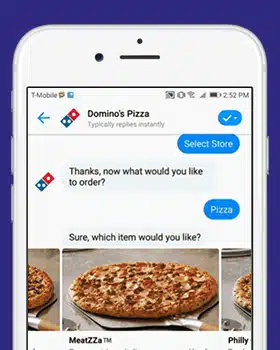

Dominos – Ordre, forespørgsler, status chatbot

Dominos chatbot, "Dom," er tilgængelig på flere platforme, herunder Facebook Messenger, Twitter og virksomhedens hjemmeside.

Dom gør det muligt for kunder at afgive ordrer, spore leveringer og modtage tilpassede pizzaanbefalinger baseret på deres præferencer. Denne AI-drevne tilgang har forbedret den overordnede kundeoplevelse og gjort bestillingsprocessen mere effektiv.

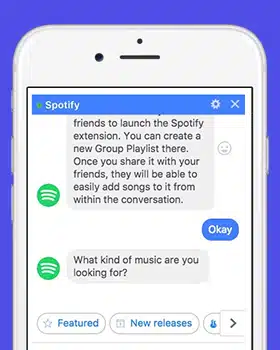

Spotify – Chatbot til at finde musik

Spotifys chatbot på Facebook Messenger hjælper brugere med at finde, lytte til og dele musik. Chatbotten kan anbefale afspilningslister baseret på brugerpræferencer, humør eller aktiviteter og endda levere tilpassede afspilningslister efter anmodning.

Den AI-drevne chatbot lader brugere opdage ny musik og dele deres yndlingsnumre direkte gennem Messenger-appen, hvilket forbedrer den overordnede musikoplevelse.

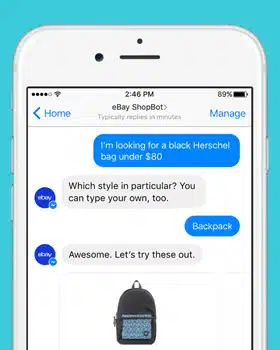

eBay – Intuitiv ShopBot

eBays ShopBot, tilgængelig på Facebook Messenger, hjælper brugere med at finde produkter og tilbud på eBays platform. Chatbotten kan give personlige indkøbsforslag baseret på brugerpræferencer, prisklasser og interesser.

Brugere kan også uploade et billede af en genstand, de leder efter, og chatbotten vil bruge billedgenkendelsesteknologi til at finde lignende varer på eBay. Denne AI-drevne løsning strømliner shopping og hjælper brugere med at opdage unikke varer og gode tilbud.

Afbød almindelige dataudfordringer i Conversational AI

Conversational AI transformerer dynamisk kommunikation mellem mennesker og computere. Og mange virksomheder er ivrige efter at udvikle avancerede AI-værktøjer og applikationer til samtale, der kan ændre, hvordan forretninger foregår. Men før du udvikler en chatbot, der kan facilitere en bedre kommunikation mellem dig og dine kunder, skal du se på de mange udviklingsmæssige faldgruber, du kan komme ud for.

Sprogmangfoldighed

I 2022, blev omkring 1.5 mia mennesker talte engelsk på verdensplan, efterfulgt af kinesisk mandarin med 1.1 milliarder talere. Selvom engelsk er det mest talte og studerede fremmedsprog globalt, kun ca 20 % af verdens befolkning taler det. Det får resten af den globale befolkning – 80 % – til at tale andre sprog end engelsk. Så når du udvikler en chatbot, skal du også overveje sproglig mangfoldighed.

Sprogvariabilitet

Mennesker taler forskellige sprog og det samme sprog forskelligt. Desværre er det stadig umuligt for en maskine fuldt ud at forstå talesprogsvariabilitet, idet der tages hensyn til følelser, dialekter, udtale, accenter og nuancer.

Vores ord og sprogvalg afspejles også i, hvordan vi skriver. En maskine kan kun forventes at forstå og værdsætte sprogets variation, når en gruppe annotatorer træner den på forskellige taledatasæt.

Dynamik i tale

En anden stor udfordring i udviklingen af en samtale-AI er at bringe taledynamik ind i kampen. For eksempel bruger vi flere fyldstoffer, pauser, sætningsfragmenter og ukodelige lyde, når vi taler. Derudover er tale meget mere kompleks end det skrevne ord, da vi normalt ikke holder pause mellem hvert ord og understreger den rigtige stavelse.

Når vi lytter til andre, har vi en tendens til at udlede hensigten og meningen med deres samtale ved at bruge vores livserfaringer. Som et resultat heraf kontekstualiserer og forstår vi deres ord, selv når det er tvetydigt. Men en maskine er ude af stand til denne kvalitet.

Støjende data

Støjende data eller baggrundsstøj er data, der ikke giver værdi til samtalerne, såsom dørklokker, hunde, børn og andre baggrundslyde. Derfor er det vigtigt at skrubbe eller filtrere lydfiler af disse lyde og træne AI-systemet til at identificere de lyde, der betyder noget, og dem, der ikke gør.

Fordele og ulemper ved forskellige taledatatyper

Hvis du leder efter en generisk datasættype, har du masser af offentlige talemuligheder tilgængelige. Men for noget mere specifikt og relevant for dit projektkrav, skal du muligvis indsamle og tilpasse det på egen hånd.

Proprietære taledata

Det første sted at søge ville være din virksomheds proprietære data. Men da du har den juridiske ret og samtykke til at bruge dine kundetaledata, kan du være i stand til at bruge dette massive datasæt til træning og afprøvning af dine projekter.

Fordele:

- Ingen yderligere omkostninger til indsamling af træningsdata

- Træningsdataene er sandsynligvis relevante for din virksomhed

- Taledata har også naturlig baggrundsakustik, dynamiske brugere og enheder.

Ulemper:

- Brug af sådanne data kan koste dig et væld af penge på tilladelse til at optage og bruge.

- Taledataene kan have sproglige, demografiske eller kundebasebegrænsninger

- Data er muligvis gratis, men du betaler stadig for behandlingen, transskriptionen, tagging og mere.

Offentlige datasæt

Offentlige taledatasæt er en anden mulighed, hvis du ikke har til hensigt at bruge dit. Disse datasæt er en del af det offentlige domæne og kunne indsamles til open source-projekter.

FORDELE:

- Offentlige datasæt er gratis og ideelle til lavbudgetprojekter

- De er tilgængelige til download med det samme

- Offentlige datasæt kommer i en række scriptede og unscripted prøvesæt.

ULEMPER:

- Omkostningerne til behandling og kvalitetssikring kan være høje

- Kvaliteten af offentlige taledatasæt varierer i betydelig grad

- De tilbudte taleeksempler er normalt generiske, hvilket gør dem uegnede til at udvikle specifikke taleprojekter

- Datasættene er typisk skæve til det engelske sprog

Forpakkede/hyldevaredatasæt

Udforsk færdigpakkede datasæt er en anden mulighed, hvis offentlige data eller proprietære indsamling af taledata passer ikke til dine behov.

Sælgeren har indsamlet færdigpakkede taledatasæt med det specifikke formål at videresælge til kunder. Denne type datasæt kan bruges til at udvikle generiske applikationer eller specifikke formål.

FORDELE:

- Du får muligvis adgang til et datasæt, der passer til dit specifikke behov for taledata

- Det er mere overkommeligt at bruge et færdigpakket datasæt end at samle dit eget

- Du kan muligvis hurtigt få adgang til datasættet

ULEMPER:

- Da datasættet er færdigpakket, er det ikke tilpasset dit projektbehov.

- Desuden er datasættet ikke unikt for din virksomhed, da enhver anden virksomhed kan købe det.

Vælg brugerdefinerede indsamlede datasæt

Når du bygger en taleapplikation, vil du kræve et træningsdatasæt, der opfylder alle dine specifikke krav. Det er dog højst usandsynligt, at du får adgang til et færdigpakket datasæt, der imødekommer de unikke krav til dit projekt. Den eneste tilgængelige mulighed ville være at oprette dit datasæt eller anskaffe datasættet gennem tredjepartsløsningsudbydere.

Datasættene til dine trænings- og testbehov kan tilpasses fuldstændigt. Du kan inkludere sprogdynamik, taledatavariation og adgang til forskellige deltagere. Derudover kan datasættet skaleres til at opfylde dine projektkrav til tiden.

FORDELE:

- Datasæt indsamles til din specifikke brugssag. Chancen for, at AI-algoritmer afviger fra de tilsigtede resultater, er minimeret.

- Styr og reducer bias i AI-data

ULEMPER:

- Datasættene kan være dyre og tidskrævende; men fordelene opvejer altid omkostningerne.

Conversational AI brugssager

En verden af muligheder for taledatagenkendelse og stemmeapplikationer er enorm, og de bliver brugt i flere industrier til et væld af applikationer.

Smarte husholdningsapparater/-enheder

I Voice Consumer Index 2021 blev det rapporteret, at tæt på 66 % af brugere fra USA, Storbritannien og Tyskland interagerede med smarte højttalere, og 31 % brugte en eller anden form for stemmeteknologi hver dag. Derudover reagerer smarte enheder som fjernsyn, lys, sikkerhedssystemer og andre på stemmekommandoer takket være stemmegenkendelsesteknologi.

Stemmesøgningsapplikation

Stemmesøgning er en af de mest almindelige applikationer inden for konversations-AI-udvikling. Om 20 % af alle søgninger udført på Google kommer fra dets stemmeassistentteknologi. 74 % af respondenterne i en undersøgelse sagde, at de brugte stemmesøgning i den sidste måned.

Forbrugere er i stigende grad afhængige af stemmesøgning til deres indkøb, kundesupport, lokalisering af virksomheder eller adresser og udførelse af forespørgsler.

Kunde support

Kundesupport er en af de mest fremtrædende brugssager af talegenkendelsesteknologi, da den hjælper med at forbedre kundens indkøbsoplevelse til en overkommelig og effektiv måde.

Medicinal

Den seneste udvikling inden for konversations-AI-produkter ser en betydelig fordel for sundhedsplejen. Det bliver flittigt brugt af læger og andre medicinske fagfolk til at fange stemmenotater, forbedre diagnose, give konsultation og opretholde patient-læge-kommunikation.

Sikkerhedsapplikationer

Stemmegenkendelse ser endnu en brugssag i form af sikkerhedsapplikationer, hvor softwaren bestemmer enkeltpersoners unikke stemmeegenskaber. Det giver adgang til eller adgang til applikationer eller lokaler baseret på stemmematchet. Stemmebiometri eliminerer identitetstyveri, duplikering af legitimationsoplysninger og misbrug af data.

Stemmekommandoer til køretøjer

Køretøjer, for det meste biler, har stemmegenkendelsessoftware, der reagerer på stemmekommandoer, der forbedrer køretøjets sikkerhed. Disse konversations-AI-værktøjer accepterer enkle kommandoer som at justere lydstyrken, foretage opkald og vælge radiostationer.

Industrier, der bruger Conversational AI

I øjeblikket bliver konversations-AI overvejende brugt som Chatbots. Men flere industrier implementerer denne teknologi for at opnå enorme fordele. Nogle af de industrier, der bruger konversations-AI er:

Medicinal

Nogle af fordelene er

- Patientinddragelse i efterbehandlingsfasen

- Chatbots til planlægning af aftaler

- Besvarelse af ofte stillede spørgsmål og generelle henvendelser

- Symptomvurdering

- Identificer kritiske patienter

- Eskalering af akutte tilfælde

ecommerce

E-handelsindustrien udnytter fordelene ved denne bedste teknologi i klassen.

- Indsamling af kundeoplysninger

- Giv relevant produktinformation og anbefalinger

- Forbedring af kundetilfredsheden

- Hjælpe med at afgive ordrer og returnere

- Svar på ofte stillede spørgsmål

- Kryds- og mersalg af produkter

Bank

- Giv kunderne mulighed for at tjekke deres saldi i realtid

- Hjælp med indskud

- Hjælpe med at indgive skat og ansøge om lån

- Strømlin bankprocessen ved at sende fakturapåmindelser, notifikationer og advarsler

Forsikring

- Giv politiske anbefalinger

- Hurtigere skadeafvikling

- Fjern ventetider

- Indsaml feedback og anmeldelser fra kunder

- Skab kundebevidsthed om politikker

- Administrer hurtigere krav og fornyelse

Shaip Offer

Når det kommer til at levere kvalitet og pålidelige datasæt til udvikling af avancerede menneske-maskine interaktion taleapplikationer, har Shaip været førende på markedet med sine succesfulde implementeringer. Men med en akut mangel på chatbots og taleassistenter søger virksomheder i stigende grad Shaip – markedslederens – tjenester til at levere tilpassede, nøjagtige og kvalitetsdatasæt til træning og test til AI-projekter.

Ved at kombinere naturlig sprogbehandling kan vi give personlige oplevelser ved at hjælpe med at udvikle nøjagtige taleapplikationer, der efterligner menneskelige samtaler effektivt. Vi bruger en række avancerede teknologier til at levere kundeoplevelser af høj kvalitet. NLP lærer maskiner at fortolke menneskelige sprog og interagere med mennesker.

Lydtranskription

Shaip er en førende udbyder af lydtransskriptionstjenester, der tilbyder en række forskellige tale-/lydfiler til alle typer projekter. Derudover tilbyder Shaip en 100 % menneskeskabt transskriptionstjeneste til at konvertere lyd- og videofiler – interviews, seminarer, foredrag, podcasts osv. til letlæselig tekst.

Talemærkning

Shaip tilbyder omfattende talemærkningstjenester ved ekspertise at adskille lyde og tale i en lydfil og mærke hver fil. Ved nøjagtigt at adskille lignende lydlyde og annotere dem,

Højttaler-diarisering

Sharps ekspertise strækker sig til at tilbyde fremragende højttalerdiariseringsløsninger ved at segmentere lydoptagelsen baseret på deres kilde. Ydermere er højttalergrænserne nøjagtigt identificeret og klassificeret, såsom højttaler 1, højttaler 2, musik, baggrundsstøj, køretøjslyde, stilhed og mere for at bestemme antallet af højttalere.

Audio Klassificering

Annotering begynder med at klassificere lydfiler i forudbestemte kategorier. Kategorierne afhænger primært af projektets krav, og de omfatter typisk brugerhensigt, sprog, semantisk segmentering, baggrundsstøj, det samlede antal talere med mere.

Natural Language Ytring Collection/ Wake-up Words

Det er svært at forudsige, at klienten altid vil vælge lignende ord, når han stiller et spørgsmål eller indleder en anmodning. F.eks. "Hvor er den nærmeste restaurant?" "Find restauranter i nærheden af mig" eller "Er der en restaurant i nærheden?"

Alle tre ytringer har samme hensigt, men er formuleret forskelligt. Gennem permutation og kombination vil de eksperter til samtale-ai-specialister hos Shaip identificere alle de mulige kombinationer, der er mulige for at formulere den samme anmodning. Shaip indsamler og kommenterer ytringer og vækkeord med fokus på semantik, kontekst, tone, diktion, timing, stress og dialekter.

Flersprogede lyddatatjenester

Flersprogede lyddatatjenester er et andet meget foretrukket tilbud fra Shaip, da vi har et team af dataindsamlere, der indsamler lyddata på over 150 sprog og dialekter over hele kloden.

Intentionsdetektion

Menneskelig interaktion og kommunikation er ofte mere kompliceret, end vi giver dem æren for. Og denne medfødte komplikation gør det svært at træne en ML-model til at forstå menneskelig tale nøjagtigt.

Desuden kan forskellige mennesker fra den samme demografiske eller forskellige demografiske grupper udtrykke den samme hensigt eller følelse forskelligt. Så talegenkendelsessystemet skal trænes til at genkende fælles hensigter uanset demografi.

For at sikre, at du kan træne og udvikle en førsteklasses ML-model, leverer vores logopæder omfattende og forskelligartede datasæt for at hjælpe systemet med at identificere de forskellige måder, mennesker udtrykker den samme hensigt på.

Hensigtsklassifikation

I lighed med at identificere den samme hensigt fra forskellige mennesker, bør dine chatbots også trænes til at kategorisere kundekommentarer i forskellige kategorier - forudbestemt af dig. Hver chatbot eller virtuel assistent er designet og udviklet med et specifikt formål. Shaip kan klassificere brugerhensigt i foruddefinerede kategorier efter behov.

Automatisk talegenkendelse eller ASR

Talegenkendelse” refererer til at konvertere talte ord til teksten; dog sigter stemmegenkendelse og højttaleridentifikation på at identificere både talt indhold og højttalerens identitet. ASR's nøjagtighed bestemmes af forskellige parametre, dvs. højttalervolumen, baggrundsstøj, optageudstyr mv.

Toneregistrering

En anden interessant facet af menneskelig interaktion er tone - vi genkender iboende betydningen af ord afhængigt af den tone, som de udtales med. Selvom det, vi siger, er vigtigt, giver den måde, vi siger disse ord, også mening på.

For eksempel en simpel sætning som "Sikke en glæde!" kunne være et udråb om lykke og kunne også have til hensigt at være sarkastisk. Det afhænger af tonen og stress.

'Hvad laver du?'

'Hvad laver du?'

Begge disse sætninger har de nøjagtige ord, men belastningen på ordene er forskellig, hvilket ændrer hele betydningen af sætningerne. Chatbotten er trænet til at identificere lykke, sarkasme, vrede, irritation og flere udtryk. Det er her ekspertisen hos Sharps talesprogpatologer og annotatorer kommer i spil.

Lyd-/taledatalicens

Shaip tilbyder uovertrufne taledatasæt af hyldekvalitet, der kan tilpasses, så de passer til dit projekts specifikke behov. De fleste af vores datasæt kan passe ind i ethvert budget, og dataene er skalerbare til at imødekomme alle fremtidige projektkrav. Vi tilbyder mere end 40 timers hyldedatasæt på mere end 100 dialekter på over 50 sprog. Vi tilbyder også en række lydtyper, herunder spontane, monologe, scriptede ord og vækkeord. Se det hele Datakatalog.

Indsamling af lyd-/taledata

Når der er mangel på kvalitetstaledatasæt, kan den resulterende taleløsning være fyldt med problemer og mangle pålidelighed. Shaip er en af de få udbydere, der leverer flersprogede lydsamlinger, lydtransskription og annotationsværktøjer og tjenester, der kan tilpasses fuldt ud til projektet.

Taledata kan ses som et spektrum, der går fra naturlig tale i den ene ende til unaturlig tale i den anden. I naturlig tale har du taleren til at tale på en spontan samtalemåde. På den anden side lyder unaturlig tale begrænset, når taleren læser et manuskript. Til sidst bliver talerne bedt om at udtale ord eller sætninger på en kontrolleret måde midt i spektret.

Sharps ekspertise strækker sig til at levere forskellige typer taledatasæt på over 150 sprog

Scriptede data

Talerne bliver bedt om at udtale specifikke ord eller sætninger fra et script i et scriptet taledataformat. Dette kontrollerede dataformat inkluderer typisk stemmekommandoer, hvor højttaleren læser fra et forudforberedt script.

Hos Shaip leverer vi et scriptet datasæt til at udvikle værktøjer til mange udtaler og tonalitet. Gode taledata bør omfatte prøver fra mange talere med forskellige accentgrupper.

Spontane data

Som i scenarier i den virkelige verden er spontane eller samtaledata den mest naturlige form for tale. Dataene kan være eksempler på telefonsamtaler eller interviews.

Shaip giver et spontant taleformat til at udvikle chatbots eller virtuelle assistenter, der skal forstå kontekstuelle samtaler. Derfor er datasættet afgørende for at udvikle avancerede og realistiske AI-baserede chatbots.

Ytringsdata

Ytringstaledatasættet leveret af Shaip er et af de mest eftertragtede på markedet. Det er fordi ytringer/wake-ord udløser stemmeassistenter og får dem til at svare intelligent på menneskelige forespørgsler.

Transcreation

Vores flersprogede færdigheder hjælper os med at tilbyde transcreation-datasæt med omfattende stemmeeksempler, der oversætter en sætning fra et sprog til et andet, mens tonaliteten, konteksten, hensigten og stilen nøje opretholdes.

Tekst-til-tale (TTS) data

Vi leverer meget nøjagtige taleeksempler, der hjælper med at skabe autentiske og flersprogede tekst-til-tale-produkter. Derudover leverer vi lydfiler med deres nøjagtigt kommenterede baggrundsstøjfrie transskriptioner.

Tale-til-tekst

Shaip tilbyder eksklusive tale-til-tekst-tjenester ved at konvertere optaget tale til pålidelig tekst. Da det er en del af NLP-teknologien og afgørende for at udvikle avancerede taleassistenter, er fokus på ord, sætninger, udtale og dialekter.

Tilpasning af taledataindsamling

Taledatasæt spiller en afgørende rolle i udvikling og implementering af avancerede samtale-AI-modeller. Men uanset formålet med at udvikle taleløsninger, afhænger slutproduktets nøjagtighed, effektivitet og kvalitet af typen og kvaliteten af dets trænede data.

Nogle organisationer har en klar idé om, hvilken type data de har brug for. De fleste er dog ikke helt klar over deres projektbehov og krav. Derfor skal vi give dem en konkret idé om lyddataindsamlingen metoder brugt af Shaip.

Demografi

Målsprog og demografi kan bestemmes ud fra projektet. Derudover kan taledata tilpasses baseret på demografien, såsom alder, uddannelsesmæssige kvalifikationer osv. Lande er en anden tilpasningsfaktor i stikprøvedataindsamlingen, da de kan påvirke projektets resultat.

Med det nødvendige sprog og dialekt i tankerne, indsamles lydeksempler for det angivne sprog og tilpasses baseret på de nødvendige færdigheder – med eller uden modersmål.

Samlingsstørrelse

Størrelsen af lydeksemplet spiller en afgørende rolle for at bestemme projektets ydeevne. Derfor er det samlede antal respondenter bør overvejes til dataindsamling. Det det samlede antal ytringer eller talegentagelser pr. deltager eller det samlede antal deltagere bør også overvejes.

Data Script

Scriptet er et af de mest afgørende elementer i en dataindsamlingsstrategi. Derfor er det vigtigt at bestemme det datascript, der er nødvendigt for projektet – scripted, unscripted, ytringer eller vågne ord.

Lydformater

Lyd af taledata spiller en afgørende rolle i udviklingen af stemme- og lydgenkendelsesløsninger. Det lydkvalitet og baggrundsstøj kan påvirke resultatet af modeltræning.

Indsamling af taledata bør sikre filformat, komprimering, indholdsstruktur, og krav til forbehandling kan tilpasses til at imødekomme projektkrav.

Levering af lydfiler

En yderst kritisk komponent i indsamling af taledata er leveringen af lydfiler i henhold til kundens krav. Som et resultat heraf er datasegmentering, transskription og mærkningstjenester leveret af Shaip nogle af de mest efterspurgte af virksomheder for deres benchmarked kvalitet og skalerbarhed.

Desuden følger vi også med filnavnekonventioner til øjeblikkelig brug og nøje overholde leveringstidslinjerne for hurtig implementering.

Vores ekspertise

Understøttede sprog

Succeshistorier

Vi har arbejdet med nogle af de bedste virksomheder og brands og har forsynet dem med samtale-AI-løsninger af højeste orden.

Nogle af vores succeshistorier inkluderer,

- Vi havde udviklet et talegenkendelsesdatasæt med mere end 10,000 timers flersprogede transskriptioner, samtaler og lydfiler til at træne og bygge en live chatbot.

- Vi byggede et datasæt af høj kvalitet med 1000-vis af samtaler på 6 omgange pr. samtale, der bruges til forsikrings-chatbot-træning.

- Vores team på 3000 plus sprogeksperter leverede mere end 1000 timers lydfiler og transskriptioner på 27 modersmål til træning og test af en digital assistent.

- Vores team af annotatorer og sprogeksperter indsamlede og leverede også 20,000 og flere timers ytringer på mere end 27 globale sprog hurtigt.

- Vores automatiske talegenkendelsestjenester er en af de mest foretrukne af branchen. Vi leverede pålideligt mærkede lydfiler, der sikrede specifik opmærksomhed på udtale, tone og hensigt ved at bruge en bred vifte af transskriptioner og leksikon fra forskellige højttalersæt for at forbedre pålideligheden af ASR-modeller.

Vores succeshistorier stammer fra vores teams forpligtelse til altid at levere den bedste service ved hjælp af de nyeste teknologier til vores kunder. Det, der gør os anderledes, er, at vores arbejde understøttes af ekspertannotatorer, som leverer upartiske og nøjagtige datasæt af guldstandard-annoteringer.

Vores dataindsamlingsteam på over 30,000 bidragydere kan hente, skalere og levere datasæt af høj kvalitet, der hjælper med hurtig implementering af ML-modeller. Derudover arbejder vi på den nyeste AI-baserede platform og har mulighed for at levere accelererede taledataløsninger til virksomheder meget hurtigere end vores nærmeste konkurrenter.

Konklusion

Vi mener ærligt, at denne guide var ressourcefuld for dig, og at du har de fleste af dine spørgsmål besvaret. Men hvis du stadig ikke er overbevist om en pålidelig leverandør, skal du ikke lede længere.

Vi, hos Shaip, er et førende dataanmærkningsfirma. Vi har eksperter inden for området, der forstår data og dets allierede bekymringer som ingen andre. Vi kan være dine ideelle partnere, når vi bringer kompetencer som engagement, fortrolighed, fleksibilitet og ejerskab til hvert projekt eller samarbejde.

Så uanset hvilken type data du vil få kommentarer til, kan du finde det veteranhold i os til at imødekomme dine krav og mål. Få dine AI-modeller optimeret til læring hos os.

Lad os tale

Ofte stillede spørgsmål (FAQ)

Chatbots er enkle, regelbaserede programmer, der reagerer på specifikke input. Samtidig bruger konversations-AI maskinlæring og naturlig sprogforståelse til at generere mere menneskelignende, kontekstuelle svar, hvilket muliggør naturlige interaktioner med brugerne.

Alexa (Amazon) og Siri (Apple) er eksempler på samtale-AI, da de kan forstå brugerhensigter, behandle talesprog og give personlige svar baseret på kontekst og brugerhistorie.

Der er ikke en endelig "bedste" konversations-AI, da forskellige platforme henvender sig til unikke use cases og industrier. Nogle populære samtale-AI-platforme inkluderer Google Assistant, Amazon Alexa, IBM Watson, OpenAI's GPT-3 og Rasa.

Konversations-AI-applikationer omfatter blandt andet kundesupport chatbots, virtuelle personlige assistenter, sprogindlæringsværktøjer, sundhedsrådgivning, e-handelsanbefalinger, HR-onboarding og event management.

Conversational AI-værktøjer er platforme og software, der muliggør udvikling, implementering og styring af AI-drevne chatbots og virtuelle assistenter. Eksempler omfatter Dialogflow (Google), Amazon Lex, IBM Watson Assistant, Microsoft Bot framework og Oracle digital assistent.